摘要:

类和实例的概念模仿了现实世界中对象的创建和行为。在现实世界中,我们有各种类型的对象,如人、动物、车辆等,每个对象都有其特定的属性(如颜色、大小、重量)和行为(如行走、说话)。类和实例提供了一种方式来模拟这些现实世界的对象及其特性。类和实例的概念可以映射到现实世界中的实体和个体。类可以代表现实世界中的一个概念或类别,而实例则代表这个类别中的一个具体个体。当团队成员使用类和实例的概念时,他们可以更容易地理解彼此的代码,并在项目中进行协作,因为类和实例提供了一种通用的沟通语言。

类和实例的概念之所以在现实世界中具有重要意义,并且简洁高效,是因为它们提供了一种模拟现实世界对象的方式,允许模块化设计、代码重用、易于维护、灵活性和扩展性,同时还简化了复杂系统的理解和设计。这些特性使得面向对象编程成为软件开发中广泛使用的方法。

PyTorch中, 熟练掌握类和实例的概念,对于使用神经网络和训练具有事半功倍的效果,也可以说,是打开 PyTorch宝库大门的一把钥匙。

在面向对象编程(OOP)中,类(Class)和实例(Instance)是两个核心概念,它们的含义和区别如下:

-

类(Class):

- 类是创建对象的蓝图或模板,它定义了一组属性(变量)和方法(函数)。

- 类是抽象的,它本身不包含具体的数据,而是提供了创建对象所需的结构和行为。

- 例如,如果我们想要创建一个表示人的类,我们可能会定义一个名为

Person的类,它包含属性如name、age和方法如speak()。

-

实例(Instance):

- 实例是根据类创建的对象,它包含了类定义的属性和方法的具体数据。

- 创建实例通常涉及到类的构造函数(Constructor),这是一个特殊的方法,用于初始化新对象的状态。

- 继续上面的例子,如果我们创建一个

Person类的实例,我们可能会写person1 = Person("Alice", 30),这里person1是Person类的一个实例,它具有name为 "Alice" 和age为 30 的属性。

-

类的调用与实例化:

- “类的调用”通常指的是使用类来创建一个或多个对象的过程,这个过程称为实例化(Instantiation)。

- 实例化是通过调用类的构造函数来完成的,构造函数的名称通常与类名相同。

-

创建实例的步骤:

- 定义一个类,包括它的属性和方法。

- 使用类名和构造函数来创建一个或多个实例。

示例代码:

# 定义一个类

class Person:

def __init__(self, name, age):

self.name = name

self.age = age

def speak(self):

print(f"Hello, my name is {self.name} and I am {self.age} years old.")

# 实例化类

person1 = Person("Alice", 30)

person2 = Person("Bob", 25)

# 使用实例的方法

person1.speak() # 输出: Hello, my name is Alice and I am 30 years old.

person2.speak() # 输出: Hello, my name is Bob and I am 25 years old.1. 模拟现实世界对象的哲学

类和实例的概念在面向对象编程(OOP)中具有重要的现实意义,并且它们之所以简洁且高效,是因为它们模拟了现实世界中对象的创建和管理方式。以下是类和实例概念在现实中的意义以及它们为何简洁高效的原因:

-

现实世界的模拟:

类和实例的概念模仿了现实世界中对象的创建和行为。在现实世界中,我们有各种类型的对象,如人、动物、车辆等,每个对象都有其特定的属性(如颜色、大小、重量)和行为(如行走、说话)。类和实例提供了一种方式来模拟这些现实世界的对象及其特性。 -

模块化:

类和实例的概念允许将数据和行为封装在一起,这有助于模块化设计。每个类都是一个独立的模块,可以独立于其他模块进行开发和测试。 -

代码重用:

通过创建通用的类,可以生成多个具有相同属性和行为的实例。这意味着相同的代码可以被重用,减少了重复劳动,提高了开发效率。 -

易于维护:

当需要修改对象的行为时,只需要修改类中的方法,而不需要修改每个实例。这使得维护和更新代码变得更加容易。 -

灵活性和扩展性:

类和实例的概念允许创建继承和多态性,这使得代码更加灵活和可扩展。通过继承,可以创建新的类,这些类继承了父类的属性和行为,同时还可以添加或修改行为。 -

抽象和简化:

类提供了一种抽象的方式,允许开发者专注于对象的接口(即对象如何被使用),而不是具体的实现细节。这简化了复杂系统的理解和设计。 -

现实世界的映射:

类和实例的概念可以映射到现实世界中的实体和个体。类可以代表现实世界中的一个概念或类别,而实例则代表这个类别中的一个具体个体。 -

设计模式的应用:

类和实例的概念是许多设计模式的基础,这些设计模式提供了解决常见软件设计问题的通用方法。使用设计模式可以提高代码的质量和可维护性。 -

提高生产力:

通过使用类和实例,开发者可以更快速地创建复杂的系统,因为它们可以重用现有的类和模式,而不是从头开始构建每个组件。 -

更好的协作:

当团队成员使用类和实例的概念时,他们可以更容易地理解彼此的代码,并在项目中进行协作,因为类和实例提供了一种通用的沟通语言。

类和实例的概念之所以在现实世界中具有重要意义,并且简洁高效,是因为它们提供了一种模拟现实世界对象的方式,允许模块化设计、代码重用、易于维护、灵活性和扩展性,同时还简化了复杂系统的理解和设计。这些特性使得面向对象编程成为软件开发中广泛使用的方法。

2. 类与实例的关系

实例(Instance)和类(Class)之间的关系是基础而重要的:

-

继承性:

实例是从类继承而来的。这意味着实例拥有类中定义的所有属性和方法。类是实例的模板,实例是根据这个模板创建的。 -

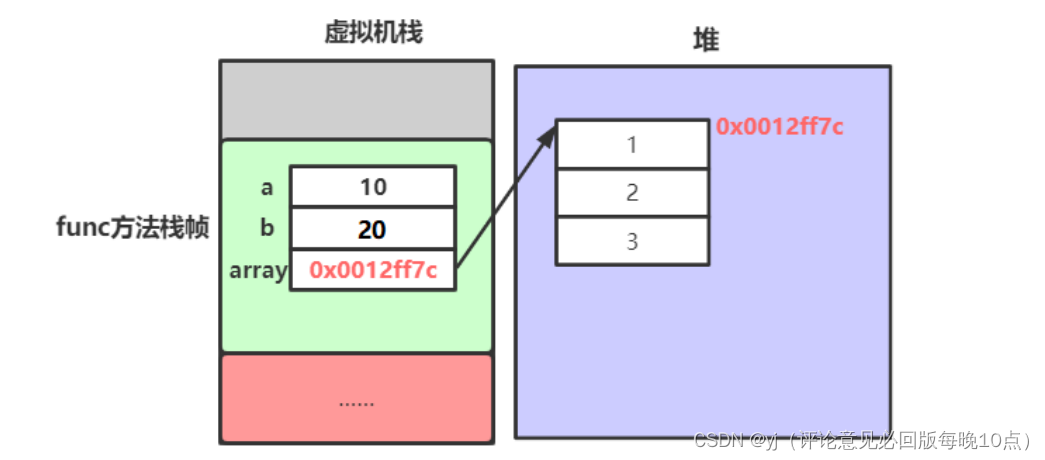

具体化:

类是抽象的蓝图,而实例是这个蓝图的具体化。当创建一个类的实例时,实际上是在内存中为该实例的属性分配了空间,并且可以调用其方法。 -

状态:

实例拥有自己的状态,即每个实例的属性值可以是独特的。尽管所有实例都共享相同的方法,但每个实例的属性值可以不同。 -

多态性:

实例可以展示多态性,即同一个方法在不同的实例中可以有不同的行为。这通常是通过方法重写(Override)实现的,子类可以提供一个特定于该子类的方法实现。 -

类是实例的类型:

在类型系统中,类不仅定义了实例的结构,还定义了实例的类型。在某些语言中,你可以将实例视为其类类型的一个对象。 -

生命周期:

类的定义在程序的整个生命周期内都是可用的,而实例的生命周期则取决于其在程序中的使用情况。实例可能会被创建和销毁,而类的定义则一直存在。 -

访问控制:

类可以定义访问控制修饰符,如私有(private)、保护(protected)和公共(public),这些修饰符决定了类的成员(属性和方法)对实例和其他对象的可见性。 -

实例化:

实例是通过调用类的构造函数(Constructor)来创建的。构造函数是一种特殊的方法,用于初始化新对象的状态。 -

自我引用:

实例可能包含对其他实例的引用,包括对同一类或其他类的实例的引用,这允许创建复杂的对象关系和数据结构。 -

类的层次结构:

在面向对象的继承体系中,一个实例可能是多个类的组合。这意味着一个实例可能继承自多个基类(通过多重继承,如果语言支持的话),并且可能实现了多个接口。

理解实例和类之间的关系对于设计和实现面向对象的软件至关重要,因为它涉及到对象的创建、行为和交互。

3.PyTorch中的神经网络类和实例

在PyTorch中,神经网络通常通过定义一个类来实现,这个类继承自torch.nn.Module。torch.nn.Module是PyTorch中所有神经网络模块的基类。下面我将解释如何在PyTorch中使用类和实例来构建一个神经网络:

-

定义一个网络类:

首先,你需要定义一个类,这个类继承自torch.nn.Module。在这个类中,你需要定义网络的结构,包括层的类型和数量。 -

初始化网络:

在类的构造函数(__init__方法)中,你会初始化网络中的层。例如,你可以添加卷积层、全连接层、循环层等。 -

定义前向传播:

你需要定义一个前向传播的方法(通常命名为forward),它指定了输入数据通过网络的正向传播过程。在这个函数中,你将定义如何使用网络层处理输入数据。 -

实例化网络:

一旦你定义了网络类,你就可以创建这个网络的实例。创建实例时,PyTorch会自动调用类的构造函数来设置网络结构。 -

训练和使用网络:

你可以使用这个网络实例来进行训练和预测。在训练过程中,你会传入训练数据,并通过优化器更新网络的权重。

下面是一个简单的LeNet网络的例子,展示了如何在PyTorch中定义和使用一个网络类:

import torch

import torch.nn as nn

import torch.nn.functional as F

# 定义网络类

class LeNet(nn.Module):

def __init__(self):

super(LeNet, self).__init__()

# 添加卷积层

self.conv1 = nn.Conv2d(1, 6, 5)

self.conv2 = nn.Conv2d(6, 16, 5)

# 添加全连接层

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

# 卷积层后使用ReLU激活函数

x = F.max_pool2d(F.relu(self.conv1(x)), 2)

x = F.max_pool2d(F.relu(self.conv2(x)), 2)

# 将卷积层的输出展平

x = x.view(-1, self.num_flat_features(x))

# 全连接层后使用ReLU激活函数

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

# 输出层不使用激活函数

x = self.fc3(x)

return x

def num_flat_features(self, x):

size = x.size()[1:] # 排除批次大小

num_features = 1

for s in size:

num_features *= s

return num_features

# 实例化网络

net = LeNet()

# 假设有一个输入数据

input = torch.randn(1, 1, 32, 32) # 假设有一个32x32的单通道图像

# 前向传播获取输出

output = net(input)

print(output) # 输出网络的预测结果 在这个例子中,LeNet类定义了一个简单的卷积神经网络。通过实例化LeNet类,我们创建了一个网络实例net,然后我们可以用它来进行前向传播,得到输入数据的预测结果。在实际应用中,你会使用大量的训练数据来训练这个网络,并通过反向传播算法来更新网络的权重。

4. PyTorch定义和使用类的方法和规则

在PyTorch中,构建和使用神经网络类和实例时,有一些基本规则和技巧可以帮助你更高效地进行深度学习模型的开发。以下是一些关键点:

基本规则

-

继承

所有神经网络类都应该继承自torch.nn.Module:torch.nn.Module基类。 -

初始化层:

在网络类的构造函数__init__中初始化所有层。这些层会作为类的属性被添加。 -

定义前向传播:

实现一个forward方法,该方法定义了数据通过网络的正向传播过程。 -

权重初始化:

可以在__init__方法中或者单独的初始化方法里对权重进行初始化。 -

使用

类的属性和方法都使用self关键字:self关键字进行引用。 -

注册层和损失函数:

使用self.add_module(name, module)注册所有层和损失函数,以便PyTorch可以追踪这些模块的参数。

类和实例的定义

- 定义网络类:

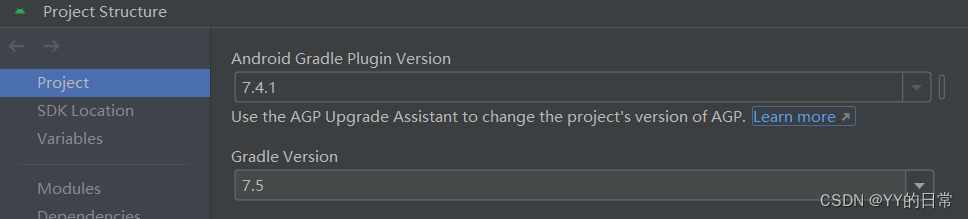

- 创建一个新的Python类,继承自

torch.nn.Module。

- 创建一个新的Python类,继承自

class MyNetwork(nn.Module):

def __init__(self):

super(MyNetwork, self).__init__()

# 初始化网络层

self.conv1 = nn.Conv2d(3, 16, kernel_size=3, stride=1, padding=1)

# 更多层...- 实例化网络:

- 使用类名直接调用构造函数来创建网络的实例。

model = MyNetwork()调用方式和技巧

-

使用

对于简单的网络结构,可以使用Sequential:torch.nn.Sequential来快速定义。 -

利用

如果你有多个相似的层需要按顺序或并行处理,可以使用ModuleList或ParameterList:ModuleList或ParameterList。 -

自定义层:

如果需要特殊的层,可以定义自己的层类,同样继承自nn.Module。 -

权重初始化:

使用nn.init模块提供的方法来初始化权重,例如nn.init.kaiming_normal_。 -

使用

将模型和数据移动到GPU或CPU,使用.to(device):.to(device)方法。 -

使用

在训练和评估阶段分别调用模型的.train()和.eval():.train()和.eval()方法,以设置适当的模式。 -

保存和加载模型:

使用torch.save和torch.load来保存整个模型或仅仅是模型的状态(权重)。 -

使用

在推理(评估)阶段,使用with torch.no_grad():with torch.no_grad()来关闭不需要计算梯度的部分,以减少内存消耗和加速计算。 -

避免在

这可能会导致梯度计算出现问题。forward方法中修改Tensor的requires_grad属性: -

使用钩子(Hooks):

PyTorch允许你在前向或后向传播过程中的特定点添加自定义操作,这可以通过注册前向钩子(register_forward_hook)或后向钩子(register_backward_hook)实现。 -

批量归一化(BatchNorm):

在卷积层之后使用批量归一化层可以提高模型的性能和稳定性。 -

激活函数的选择:

根据问题的性质选择合适的激活函数,如ReLU、LeakyReLU、PReLU等。

通过遵循这些规则和技巧,你可以更有效地在PyTorch中定义、实例化和使用神经网络。

](https://img-blog.csdnimg.cn/direct/e060f6625e6748fa91a19ef5cb8f3ede.png)

![[muduo网络库]——muduo库的Reactor模型(剖析muduo网络库核心部分、设计思想)](https://img-blog.csdnimg.cn/direct/a2042af6c540482c8b6e5607edeccb9a.png)